学会了破坏,你就学会了创造

那位师父姓姚,村里人都叫他姚还原。

他的本事在山外都传开了——任何破碎的瓷瓶,他都能复原。哪怕只剩下一堆碎片,哪怕碎得已经看不出形状,他都能让那只瓶子完整地坐回桌上。

少年是他在七十二岁那年收的最后一个徒弟。他姓林,十四岁,从小手巧。第一天到师父家,他原以为会看到师父在拼瓶子——把碎片一片一片粘起来。

但他看到的完全不是这件事。

师父在桌上摆了一只完整的青花瓶。少年正想问"为什么有完整的瓶子",师父拿起一个小榔头,敲了一下——瓶口出现一道细微的裂纹。师父把这只瓶子放在角落,又从柜子里取出一只几乎一样的瓶子,敲两下,出现两道裂纹。第三只敲三下,第四只敲四下……一路敲下去,第三十只瓶子已经完全是一堆瓷片了,第五十只已经是粗砂,第一百只已经是细到呼吸都能吹散的尘土。

师父把这一百只从完整到尘土的瓶子,按顺序排在长桌上。

少年看了半天,问:"师父,你为什么要砸瓶子?"

师父说:"我不是砸瓶子。我是在练我的眼睛。"

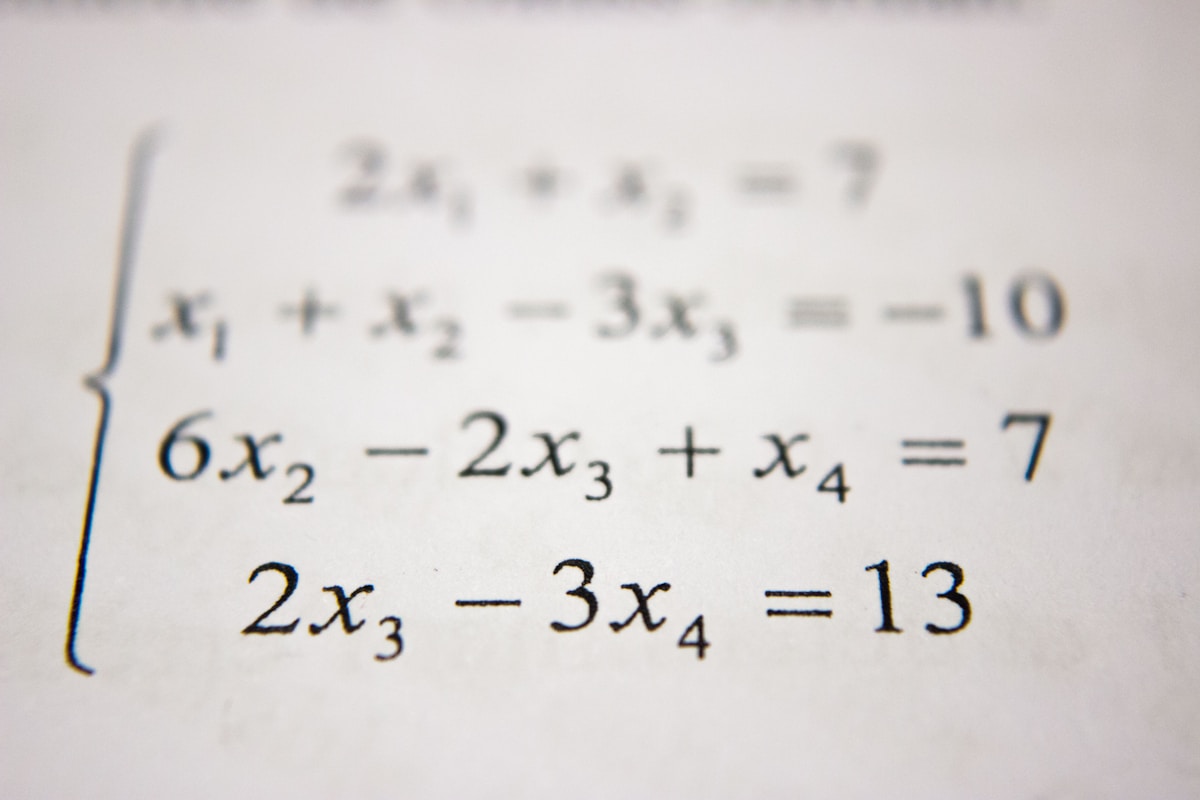

第二天,师父让少年做的事情更让人摸不着头脑。他指着排在桌上的第一百只瓶子(那已经是一堆尘土),说:

你看着这堆尘土。你能不能告诉我,如果它再多一点点尘土、再少一点点尘土,会更接近哪一边的瓶子?

少年盯着那堆尘土看了半天:"师父,这……就是一堆尘土啊。我看不出哪一面比哪一面更像瓶子。"

师父笑了:"你不会看,但我会。这一堆尘土的左边比右边稍微集中一点点,所以它更接近 第九十九 号——也就是再多复原一点点就会变成 第九十九 号。我把它朝着这个方向轻轻拨一下——"

少年看着师父用一根细棍子,几乎看不见地拨动了一下那堆尘土。

"——它现在就是 第九十九 号了。"

少年不能相信。他低头看,那堆尘土跟刚才几乎一模一样——但师父说它是 第九十九 号。

师父继续:"现在,第九十九 号是不是又有一种再让它'更像'第九十八号 的趋势?我把它再朝那个方向拨一下,它就成了 第九十八号。再拨,第九十七 号。再拨,第九十六 号……一直拨,直到它成了 第一 号——一只完整的青花瓶。"

少年这才隐隐明白——师父这一辈子在练的本事,不是 '修复破瓶'——是练就一双眼睛,对着任何一堆尘土,他都能判断 "下一步该把哪一粒拨到哪里",才会更像一只瓶子。

复原那只完整的青花瓶,不是一次性的拼接——是一百次微小的拨动。每一次拨动让它离尘土稍远一点、离瓶子稍近一点。

少年问:"那师父,你怎么知道它本来就是青花瓶,不是别的瓶子?"

师父回答:"我不知道。我让它变成什么样,它就是什么样。如果我心里想的是青花瓶,我每一步拨动的方向就会朝青花瓶;如果我想的是白瓷瓶,每一步就会朝白瓷瓶。这堆尘土自己没有形状——形状是我每一步'决定不要哪一部分'累积出来的。"

林听完,第一次明白他师父的真本事是什么。

师父收徒前曾对人说过一句话,很多年后林才理解:

想学会做瓷瓶,你要先学会怎么把瓷瓶变成尘土。 想学会创造一样东西,你要先学会它从有到无的每一步。 如果你认得这一百步,你就能反过来走完——从尘土,变成那只瓶子。

寓言之外

这就是 Diffusion Models(扩散模型)——驱动 DALL-E 2、Stable Diffusion、Midjourney、Sora、Imagen 这些 2022 年之后所有最强图像/视频生成模型的核心算法。

把任何一张真实图片想象成那只完整的青花瓶。Diffusion 模型的训练分两步:

第一步:学会"破坏"——前向扩散过程(Forward Diffusion)

给一张干净图像,一步一步地往它上面加噪声(随机数)。第一步加一点点,图像几乎不变;第二步再加一点点,稍微模糊;第三步、第四步……加到第 1000 步左右,图像完全变成了纯随机噪声——和高斯白噪声分布一致,看不出任何信息。

这一步不需要训练任何模型——加噪声的方法是数学上预定义的(每一步加一个特定方差的高斯噪声)。这就是寓言里师父"敲瓷瓶"的过程——每敲一次破坏一点,直到完全成为尘土。

第二步:学会"恢复"——反向去噪过程(Reverse Denoising)

训练一个神经网络去做这件事:给我一张被加了 t 步噪声的图像,你预测出第 t 步加入的那点噪声是什么(或者等价地说,预测把它去掉一点点之后的图像是什么样)。

这是 Diffusion 模型唯一真正的训练目标。它在做"局部去噪"——每一步只去掉一点点噪声,从而让图像从纯噪声一步步恢复到清晰。这就是寓言里师父"朝瓶子方向拨一下尘土"的本事。

训练时,模型见过几百万张真实图像在不同噪声水平下的样子,它学会了在任何噪声水平下,知道"该往哪个方向去噪"才能更接近真实图像。

生成新图像怎么用?

很简单——从纯随机噪声开始(随便从高斯分布抽一个张量),反复让训练好的模型去噪——一千次微小的去噪步骤之后,这堆随机噪声会被一步步雕琢成一张完整的图像。

这张图像不是任何训练集里的图像——它是模型"想象"出来的、符合训练数据分布的一张新图像。

整个过程,寓言里说得已经很清楚:模型不是"知道这堆尘土本来是什么瓶子",它是 "在每一步,知道把谁拨到哪里,会让结果更像它见过的那些瓶子"。每一步都是一个朝着自然图像分布的微小爬坡——一千步之后,你抵达了那个分布上的一个具体点(一张图)。

为什么这件事这么强大?

Diffusion 不是一次性生成,而是分一千步生成——每一步只解决"再去一点噪声"这种相对简单的问题。整体复杂的'生成'被拆成了一千步极简的'去噪'。这让训练目标变得平滑、可学,也让生成质量远超 GAN 那种一次到位的方式。

条件生成(Text-to-Image)只需要给去噪过程加一个'指南针'——告诉模型"我想要的是一只青花瓶,不是白瓷瓶",模型每一步去噪时,会朝向'青花瓶'的方向去噪。这就是"prompt"的本质——它不是被一次性扔给模型,它是在每一个去噪步骤中被反复参考的指南针。

生成多样性自然涌现——同样一句 prompt,从不同的随机起点出发,会走到不同的最终图像。起点的随机性 + 每步去噪的微小随机性,共同造就了 Stable Diffusion 这种"同一个 prompt 给我看 N 张不同结果"的能力。

Diffusion 在数学上极其优美——它有一个干净的概率论框架(随机微分方程,SDE),每一步去噪等价于在一个学得到的"势能场"里做梯度下降。这种数学优美让它易于扩展、易于改进——条件控制(ControlNet)、加速(DDIM、consistency models)、3D 生成、视频生成,全都是同一个核心思想的各种变体。

更深一层——Diffusion 揭示了一种关于"创造"的奇妙直觉:

创造不是从零开始构建一个完美的东西;创造是从一片混沌中,一步一步地'决定不要什么'。

雕塑家 Michelangelo 据说说过:"雕塑就在大理石里,我只是把多余的部分去掉。" Diffusion 模型用数学的方式实现了这句话——它在纯噪声里,看到了所有可能的图像;它做的事就是反复地'去掉那些不该是的',直到只剩下"该是的"。

这是一种关于创造性的全新世界观:不是"无中生有",而是"通过反复的拒绝,从一片可能性中,显化出一个具体的存在"。

姚师父没有读过深度学习的论文。但他用一辈子练的那双眼睛,和今天数十亿人在用的那种 AI,在底层是同一回事。

在 AI 史的位置

Diffusion 的种子在 2015 年 由 Jascha Sohl-Dickstein 等人在论文 Deep Unsupervised Learning using Nonequilibrium Thermodynamics 中种下——一篇灵感来自统计物理学(非平衡热力学)的论文,提出了"逐步加噪 + 学习去噪"的思想。论文当时没有引起广泛关注,因为图像生成的主战场被 GAN 占据。

2020 年 Jonathan Ho 等人发表 DDPM(Denoising Diffusion Probabilistic Models)——把 Sohl-Dickstein 的思想用现代神经网络架构(UNet)+ 简化的损失函数实现,生成质量第一次和 GAN 拉开差距。这篇论文是 Diffusion 的真正起点。

2021-2022 年 Diffusion 全面爆发:

- DALL-E 2(OpenAI, 2022 年 4 月)——大规模文本到图像

- Imagen(Google, 2022 年 5 月)

- Stable Diffusion(Stability AI + LMU + RunwayML, 2022 年 8 月)——开源,引爆全球

- Midjourney(2022 年 7 月)——商业化精品

2023-2026 年 Diffusion 扩展到所有模态:

- 视频生成(Sora, 2024;Veo, Kling)

- 3D 生成(DreamFusion, Stable Fast 3D)

- 音频生成(AudioLDM, Stable Audio)

- 分子生成(用于药物设计)

- 机器人动作生成(Diffusion Policy)

到 2026 年,Diffusion 替代了 GAN 成为生成模型的主导范式。任何今天的 AI 生成图像、视频、音乐——几乎全部底层都是从一堆随机噪声里,被一步步雕琢出来的。

姚师父的那一双眼睛,现在每天为世界生成上亿张图。

版权声明: 如无特别声明,本文版权归 sshipanoo 所有,转载请注明本文链接。

(采用 CC BY-NC-SA 4.0 许可协议进行授权)

本文标题:17. 能把尘土还原成瓷瓶的人

本文链接:https://www.sshipanoo.com/blog/ai/ai-fables/17-能把尘土还原成瓷瓶的人/

本文最后一次更新为 天前,文章中的某些内容可能已过时!